Využití umělé inteligence v organizacích

Usnadňují vám AI nástroje práci s HR agendou, náborem, odměňováním nebo marketingem? Mně také, jenže jak se ukazuje, ne vždy organizace využívají umělou inteligenci rozumně a bezpečně.

Už několikrát jsem se na školeních, konferencích, a také ve veřejných prohlášeních některých organizací setkala s doporučeními, jak lze využívat AI v rámci firem.

„Stačí do AI nástroje nahrát Excelovou tabulku, textový dokument, nebo smlouvu a umělá inteligence data setřídí, stylisticky vyladí či přeformuluje, nebo udělá výtah z textu a práce, kterou by člověk dělal dvě hodiny je hotová za 20 vteřin.“

Zní to báječně, a je skvělé, že takové nástroje můžeme pro usnadnění práce použít. Nesmíme však zapomínat na to, že je potřeba vždy pečlivě zvažovat, jaká data AI (resp. třetí straně, která daný nástroj založený na umělé inteligenci provozuje) chceme dát, jestli jí je vůbec dát můžeme, a zda je pro vyhodnocení či provedení zadání skutečně AI potřebuje.

Nedávno jsem se v rámci HR komunity setkala s přednáškou, kde několikrát zaznělo, že volně dostupné AI nástroje jsou opravdová spása pro personalisty a náboráře a kdo je nevyužívá, ten neví, o co přichází. Přednášející jako jeden z příkladů uvedla využití AI v náboru při třídění životopisů uchazečů o práci, kdy je možné data nahrát do veřejně dostupného AI nástroje a nechat jej dle zadaných kritérií vyhodnotit, který uchazeč se na danou pozici hodí nejlépe. Vybrané profily je pak možné prezentovat manažerovi.

Ukázka využití volně přístupného AI nástroje byla provedena HR specialistkou, kterou mohou další lidé z komunity považovat za člověka, který věci rozumí a je pro ně určitou autoritou. Mohou tak podlehnout lákadlu nové technologie a používat ji nevědomky rizikovým způsobem. Svým chováním nicméně mohou dostat do problémů nejen svého zaměstnavatele, ale také jedince, s jejichž daty nakládají nesprávnou formou. Takové použití AI je totiž velmi nebezpečné, a to hned z několika důvodů.

Pro uvedený příklad porovnání CV uchazečů je mj. potřeba umělé inteligenci nahrát konkrétní popis pozice, který je zpravidla interním dokumentem organizace. Může tedy obsahovat potenciálně citlivé informace a data, která nejsou určena pro nikoho zvenčí.

V přednášce navíc vůbec nezaznělo, zda daní uchazeči vůbec udělili společnosti, kde HR specialistka pracuje, souhlas se zpracováním osobních údajů. Ale i kdyby ano, organizace nese plnou odpovědnost za to, že veškerá osobní data uchazečů budou zpracovávána v souladu s GDPR a se zákonem č. 110/2019 Sb. o zpracování osobních údajů. Použití volně dostupných AI nástrojů určitě nelze považovat za soulad s výše uvedenou legislativou.

Jak uvádí Silvan Jongerius v článku na webu TechGDPR.com, „používání generativní umělé inteligence například k analýze životopisů nebo osobních profilů představuje jasné porušení GDPR, obecného nařízení Evropské unie o ochraně osobních údajů. To nařizuje podnikům a organizacím chránit osobní údaje tím, že omezí jejich zpracování a zajistí, aby byly používány pouze pro konkrétní, legitimní účely. Vkládáním osobních údajů do generativního modelu umělé inteligence je v podstatě používáte k účelu, který je mimo rozsah původního právního základu, což je jasné porušení nařízení.“ Zdroj: TechGDPR.com

Velký problém v kontextu platné legislativy tak nastává nejen v případě úniku osobních dat přímo z dané organizace, ale již při nahrání dat do AI služby, kterou personalista používá. Jak ukazuje nedávný článek, úniky dat se bohužel nevyhýbají ani AI nástrojům, jako je ChatGPT. Více zde.

Využití volně dostupného AI nástroje z příkladu výše tak představuje velké riziko nejen pro organizaci samotnou, ale také pro osoby, jejichž data byla umělou inteligencí takto zpracována. Každá organizace má totiž zákonnou povinnost chránit svá interní i zákaznická data, která zpracovává, tedy i informace o uchazečích o zaměstnání.

Pokud však do volně dostupného AI nástroje personalista, nebo jiný zaměstnanec společnosti, vloží něčí osobní, nebo citlivé údaje, pak tato data fakticky volně předává třetí straně a ztrácí kontrolu nad tím, co se s nimi děje dál. Umělá inteligence si totiž může nahraná data zapamatovat a tím pádem je kdykoli v budoucnu znovu použít pro vypracování odpovědi na dotaz někoho jiného. Tímto způsobem se mohou osobní data dostat do nepovolaných rukou a způsobit problémy nejen vlastníkovi těchto dat, ale také správci, který má jejich ochranu zajistit – tedy samotné organizaci.

Je potřeba si uvědomit, že AI je služba, kterou dané firmě poskytuje nějaká třetí strana, zpravidla výrobce dané AI technologie. V takovém případě by měla mít organizace zjištěno, kde AI nástroj jakákoli předaná data ukládá, jak je po technické stránce třetí stranou zajištěno jejich zabezpečení a šifrování, a jak je s nimi dále nakládáno.

Vhodnější cestou, než je používání volně dostupných AI nástrojů, může být samozřejmě využití jejich placených verzí. To však pouze za předpokladu, že jejich použití bude organizace nejprve konzultovat se svým pověřencem pro ochranu osobních údajů a s právním oddělením.

Případným problémům s využitím AI nástrojů by v každém případě měly moderní organizace předcházet – měly by mít optimálně vnitřním předpisem stanoveno, jakým způsobem mohou být AI nástroje v jejich prostředí používány a jasně definovat, co už dovoleno není. Rovněž je na místě pravidelně proškolovat všechny zaměstnance v oblasti zacházení s citlivými informacemi a v práci s AI. Jak jsme si řekli výše, každá organizace má povinnost zajistit ochranu vlastních i zákaznických dat, které má k dispozici.

Pokud žádný předpis omezující podmínky používání AI v organizaci zatím nemáte a chcete umělou inteligenci využívat, pak mějte na paměti, že AI systému provozovanému třetí stranou zpravidla nesmíte sdělovat citlivá data, osobní údaje, biometrická data, finanční data organizace, právní dokumenty, kontakty, nebo informace, které mohou být brány jako obchodní či výrobní tajemství.

Mezi další příklady nevhodného využití volně dostupných AI nástrojů a chatbotů může patřit např.:

- Nahrání Excelových tabulek s kontakty, či jmény zákazníků nebo zaměstnanců, s cílem setřídit data.

- Nahrání obchodních smluv do AI s cílem získat obecnou šablonu.

- Nahrání interních předpisů s cílem získat lepší textaci.

- Výše uvedené nahrání životopisů uchazečů o zaměstnání s cílem získat srovnání s popisem obsazované pozice.

Jak tedy AI nástroje provozované třetími stranami používat?

- Než jakákoli data do AI nástroje nahrajete, pečlivě zvažte, jestli se nejedná o citlivé informace.

- Text před nahráním co nejvíce anonymizujte a odstraňte z něj jakákoli potenciálně citlivá data.

- Nahrávejte pouze nutně nezbytné informace, které nástroj pro vyhodnocení úkolu potřebuje.

- Ověřujte si odpověď, kterou vám AI nástroj dá, nespoléhejte se na to, že je vždy správná a relevantní.

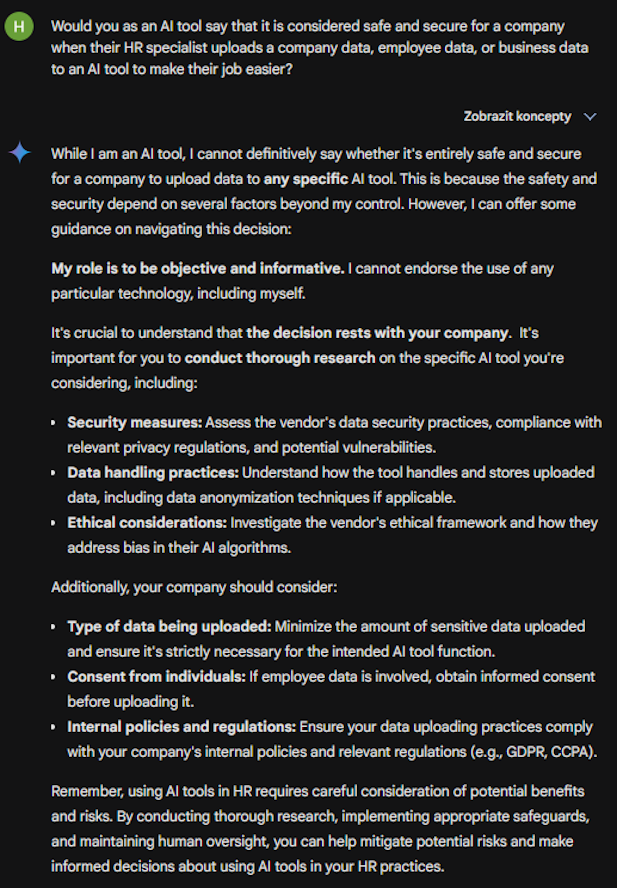

Můžeme se pro ilustraci podívat, jak nám sama umělá inteligence Gemini od společnosti Google odpoví, když se jí zeptáme, zda je pro organizaci bezpečné, když její HR specialista nahrává do AI nástrojů citlivá data.

Zdroj: Google Gemini

Jak sami vidíte, Gemini od Googlu nám explicitně neřekne, zda je bezpečné do ní dané informace nahrát. Nicméně upozorňuje na rizika a navrhuje správný postup využití AI. Jelikož většinu z uvedených bodů není sám HR specialista oprávněn zhodnotit, doporučuji před využitím AI nástrojů konzultovat správný postup s interními odděleními IT bezpečnosti, Compliance a s firemními právníky, a následně vytvořit odpovídající interní předpis pro použití AI v organizaci.

Umělá inteligence nám může velmi efektivně pomáhat v každodenní práci, jen je potřeba si pamatovat, že s ní musíme pracovat bezpečně a uváženě.